SK그룹이 폭발적으로 늘어나는 인공지능(AI) 수요에 대응해 반도체와 데이터센터를 아우르는 'AI 인프라 기업'으로의 전환을 본격화했다. 엔비디아·오픈AI·아마존웹서비스(AWS) 등 글로벌 빅테크와의 협력 구도를 전면에 내세워 HBM(고대역폭메모리) 공급 병목을 해소하고 한국이 글로벌 AI 3대 축 안에 자리 잡도록 하겠다는 구상이다.

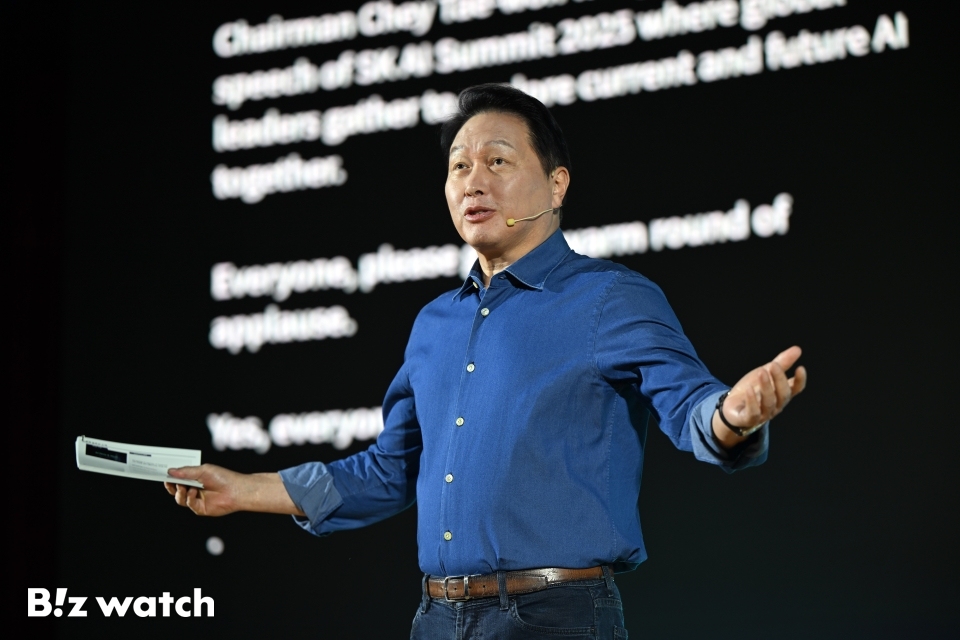

최태원 SK그룹 회장은 3일 서울 강남 코엑스에서 열린 'SK AI 서밋 2025' 기조연설에서 "SK그룹은 생산능력을 확대하고 기술 혁신을 통해 메모리 병목 현상을 풀어가고 있다"며 "AI 산업은 이제 '스케일'이 아니라 '효율'의 경쟁으로 진입했다"고 말했다. 그는 "AI 산업이 폭발적으로 성장하고 있지만 무한한 확장은 불가능하다"며 "트럼프 행정부 2기가 AI와 제조 데이터센터를 전략 산업으로 지정하면서 글로벌 인프라 투자가 한층 가속화되고 있다"고 덧붙였다.

올해 서밋에는 샘 올트먼 오픈AI CEO와 앤디 제시 AWS CEO가 영상으로 참여, 엔비디아와 TSMC 관계자들도 참석했다. SK그룹의 AI 행사에 이들 3대 글로벌 파트너가 한자리에 모인 것은 SK가 향후 메모리·데이터센터·제조 AI를 하나의 패키지로 엮어 '토털 AI 인프라 솔루션 기업'으로 도약하겠다는 의지를 분명히 한 것으로 해석된다.

공급망 압박 'SK가 선봉에 섰다'

최 회장은 AI 산업의 폭발적인 수요 증가부터 짚었다. 그는 "AI 데이터센터 투자 규모는 2020년 2300억달러에서 올해 6000억달러로 늘었다. 앞으로는 빅테크와 신규 기업들의 투자가 더 폭발적으로 증가할 것"이라고 말했다.

수요 확대의 배경으로는 △AI 추론(인퍼런스)의 본격화 △B2B 도입 확산 △24시간 작동하는 '에이전트 AI'의 등장 △국가 간 '소버린 AI' 경쟁을 꼽았다. "AI가 스스로 답을 검증하는 과정이 반복되면서 GPU와 메모리 사용량이 기하급수적으로 늘고 있다"며 "이제 학습 성능보다 공급이 문제"라고 진단했다.

최 회장은 "예전엔 GPU 하나에 HBM 하나를 연결했지만 지금은 12개 이상을 붙이는 구조로 바뀌었다. 결국 성능이 아니라 공급 자체가 병목이 되고 있다"고 말했다. 이어 "요즘 너무 많은 기업이 메모리 칩을 요청하고 있다"며 "공급이 늦어지면 고객의 사업이 멈출 수도 있어 그만큼 책임감을 느낀다"고도 덧붙였다.

현장의 메시지도 같았다. 샘 올트먼 오픈AI CEO는 영상을 통해 "모든 개인이 자신만의 지능형 AI 어시스턴트를 갖는 세상을 준비 중"이라며 "이런 미래를 위해선 막대한 인프라 투자와 긴밀한 협력이 필요하다"고 말했다.

올트먼 CEO는 "차세대 AI 인프라 구축을 위해 '스타게이트(Stargate)' 프로젝트를 출범했고 SK는 그 핵심 파트너"라며 "SK와의 협력은 단순한 비즈니스가 아니라 글로벌 AI 생태계를 함께 만드는 일"이라고 강조했다.

'스타게이트'는 오픈AI가 향후 4년간 4000억달러(약 550조원)를 투입해 미국 전역에 초대형 AI 데이터센터를 구축하는 프로젝트다. 차세대 생성형 AI 모델 학습을 위한 연산 인프라를 새로 짜는 구상으로, 웨이퍼 기준 월 90만장 규모 고성능 D램이 필요할 것으로 예상된다.

올트먼 CEO가 요구한 '월 90만장'은 현재 전 세계 HBM 생산량의 두 배에 해당한다. 이에 대해 최 회장은 "샘 올트먼 CEO도 미래 AI 주도권을 확보하려면 HBM 병목이 가장 큰 과제임을 잘 알고 있다"며 "GPU 성능이 아무리 높아도 메모리 대역폭이 받쳐주지 않으면 AI 학습 속도를 끌어올릴 수 없다"고 말했다.

그러면서 "메모리는 단순 부품이 아니라 AI 인프라의 동맥"이라며 "생산능력(CAPA) 확충 없이는 글로벌 AI 생태계가 멈출 수 있다"고 강조했다.

젠슨 황도 인정한 기술력

이에 SK는 설비 투자와 기술 혁신을 양축으로 돌파구를 열고 있다. SK하이닉스는 청주에 HBM 양산을 맡는 신규 팹 'M15X'에 장비 반입을 시작했으며 내년부터 본격 가동에 들어간다. 2027년에는 용인반도체클러스터가 문을 열 예정이다.

최 회장은 "용인 클러스터에는 대형 팹 4개가 들어가고 각 팹은 청주 M15X 6개 규모"라며 "완공 시점엔 M15X 24개가 동시에 돌아가는 셈"이라고 설명했다.

그는 "투자 부담이 크지만 공급 부족 사태를 막기 위해 속도를 낼 것"이라며 "효율을 높이지 않으면 AI가 몇몇 나라와 기업의 전유물이 될 것"이라고 강조했다. "리소스가 적은 나라와 기업도 접근할 수 있는 구조를 만드는 게 SK의 미션"이라는 말도 덧붙였다.

기술 혁신도 병행된다. SK하이닉스는 초고용량 메모리 칩을 개발하거나 낸드(NAND) 개념을 접목해 생산 효율을 높이는 방안을 추진 중이다. 최 회장은 "SK하이닉스의 기술력은 이미 업계에서 충분히 입증됐다"며 "젠슨 황 엔비디아 CEO도 이제는 개발 속도를 묻지 않는다. 그만큼 우리가 준비돼 있다는 뜻"이라고 말했다.

AI 인프라 전선도 한층 넓어지고 있다. 앤디 제시 AWS CEO는 "한국 기업들이 빠른 혁신 압박과 복잡한 고객 요구, 효율적 확장이라는 과제에 직면해 있다"며 "SK와 AWS가 울산에 약 7조원 규모로 구축 중인 100MW급 AI 데이터센터가 그 해법이 될 것"이라고 밝혔다. "SK와의 파트너십이 특별한 이유는 우리가 대규모 AI 운영에서 얻은 교훈을 함께 적용하고 있기 때문"이라며 "반도체를 포함한 차세대 분야에서도 협력 여지가 많다"고도 했다.

이 같은 흐름 속에서 SK하이닉스는 엔비디아 GPU와 '옴니버스(Omniverse)' 기반 디지털 트윈을 도입해 완전 자율형 반도체 공장 구축에 나섰다. 최 회장은 "AI의 문제를 푸는 건 결국 AI"라며 "생산 속도를 높이고 데이터센터 운영을 자동화·가상화해 효율을 극대화하겠다"고 말했다. 제조 AI 솔루션은 스타트업과 외부 산업에도 개방해 생태계 확장으로 이어갈 계획이다.

한편, 올해 서밋은 규모도 크게 확장됐다. SK텔레콤·SK하이닉스·SK E&S 등 주요 계열사는 물론 AWS·엔비디아·슈나이더 일렉트릭·앤트로픽 등 해외 기업과 학계·연구기관이 참여해 AI 데이터센터·AI 에이전트·AI 팩토리 기술을 선보였다.

SK그룹 관계자는 "SK AI 서밋이 국내 최대 AI 컨퍼런스로 자리 잡았다"며 "신뢰 기반의 글로벌 협력으로 '한국형 AI 생태계'를 구축하고 AI 3대 강국 전략을 뒷받침할 것"이라고 말했다.