정부가 '국가 인공지능(AI) 윤리기준안'을 공개했다. 사람을 이롭게 하는 인공지능이 되도록 이끄는 일종의 가이드라인이다.

그러나 선언적 표현들이 많고 구체성이 부족하다는 점에서 개선이 요구되고 초기 단계인 산업 전반에 대한 부정적 인식이 커져 자칫 규제 강화로 이어질 수 있다는 우려도 나오고 있어 확정까지 진통을 겪을 전망이다.

◇ 인공지능(AI) 윤리기준안 발표…"인간을 위한 것이어야"

7일 과학기술정보통신부와 정보통신정책연구원은 지난달 말 발표한 '국가 인공지능 윤리기준' 관련 공청회를 열고 오는 15일까지 시민 의견도 공개 접수한 뒤 이달 중순 대통령 직속 4차산업혁명위원회 심의를 거쳐 기준을 확정할 계획이다.

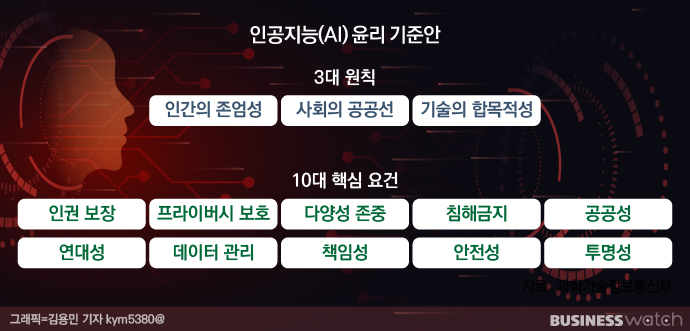

인공지능 윤리기준안은 인간성을 최고원칙으로 삼고, ①인간의 존엄성 ②사회의 공공선 ③기술의 합목적성 등 3대 원칙 아래 ①인권 보장 ②프라이버시 보호 ③다양성 존중 ④침해금지 ⑤공공성 ⑥연대성 ⑦데이터 관리 ⑧책임성 ⑨안전성 ⑩투명성 등 10대 핵심 요건을 AI 개발과 활용의 모든 과정에서 충족돼야 한다는 내용을 담았다.

윤리기준안이 마련되는 배경은 인공지능 기술의 발전이 생산성과 편의성을 높여 국가 경쟁력을 높이고 삶의 질을 높일 것으로 기대되지만, 한편으로는 기술 오남용과 데이터 편향성과 같은 윤리적 문제도 제기되고 있기 때문이다.

인공지능이 흑인 여성 사진을 고릴라로 오인하고, 인공지능 스피커가 이용자의 음성을 제3자에 무단으로 전송하며, 스마트폰으로 소비한 사람의 데이터만 서비스 개발에 활용하는 등 우리 삶을 편리하게 만드는 기술이 문제를 일으키는 사례가 이미 벌어지고 있다는 것이다.

김정원 과기정통부 정보통신정책실장은 "인공지능은 인간을 도울 수도, 위기에 몰아넣을 수도 있는 기술"이라며 "인류에 도움이 되게 하려면 인류가 합의할 수 있는 원칙과 기준을 마련해야 한다"고 말했다.

◇ 규제 강화로 가선 안 돼…"인간 vs AI는 시기상조…인간과 인간의 충돌 문제부터"

이와 관련 아직은 개발 초기 단계에 머무는 인공지능에 대한 과도한 우려를 정부 차원에서 내놓으면 이에 대한 부정적 인식이 퍼지면서 산업 전반을 침체 시킬 수도 있다는 우려 역시 함께 나온다.

공청회에서 임선경 지능정보산업협회 사무국장은 "인공지능은 소프트웨어일 뿐인데, 기준안의 표현을 보면 10년 뒤 인공지능을 보고 있어 향후 규제로 흐르지 않을까 하는 우려의 목소리가 업계에 있다"며 "기준안은 산업 활성화를 위해 신뢰성을 높이는 제도 같은 것이 정립되는 차원에서 논의해야 한다"고 당부했다.

서정연 서강대 컴퓨터공학과 교수도 "인공지능의 윤리성을 얘기하기 시작하면 인공지능이 비윤리적이란 인식을 갖게 할 수 있다"며 "인공지능은 아직 초기 단계여서 아무 것도 없는데, 규제부터 만들자는 얘기가 나올 수도 있다"고 우려했다.

그러면서 "데이터 편향성 문제가 있다지만 사실 우리 사회가 이미 편향된 상태이고, 기술 오남용 문제는 인공지능이 아닌 분야에서도 문제가 되는 이슈이고, 개인정보보호 역시 법으로 강하게 규제하고 있어 풀어달라고 하는 실정"이라며 현실과 맞지 않은 기준안이라고 했다.

윤리기준안의 구체성이 상당히 떨어진다는 지적도 나온다. 나연묵 단국대 컴퓨터공학과 교수의 경우 인간과 인공지능 사이의 우선 순위보다는 인간과 인간 사이의 이해 관계가 충돌할 때 구체적으로 어떤 원칙을 기준으로 할 것인지 명확하게 해야 한다고 강조했다.

그는 "자율주행차가 운전자와 보행자 가운데 누구를 보호해야 하는지와 같이 인간과 인간 가운데 누구를 선택해야 하는지가 기준안에서 명확하게 드러나지 않는다"고 지적했다.

변순용 서울교대 윤리교육학과 교수도 "기준안은 최고의 가치를 인간성이라고 말하는데, 그렇다면 인간성이 무엇인가에 대한 체계화 작업이 필요하다"며 "프라이버시와 공공성과 같이 각 원칙들이 상충할 때 실제 상황에서 어떻게 해야 할 것인지도 다뤄야 한다"고 말했다.