페이스북은 특정 대상에 대한 공격이 있는 내용을 혐오발언으로 정의하고 관련 페이스북 콘텐츠를 제재한다. 이외에도 페이스북은 사용자들이 자유롭게 표현하면서도 안전하게 페이스북을 사용할 수 있도록 커뮤니티 규정을 정하고 이를 위반한 경우 적절한 조치를 취하고 있다.

페이스북은 28일 서울 강남구 페이스북코리아 사무실에서 미디어세션을 열고 페이스북 콘텐츠 커뮤니티 규정과 집행 현황을 발표했다.

유해 콘텐츠 제재·확실한 기준 발표

페이스북은 혐오발언, 따돌림 및 괴롭힘, 극단주의적 콘텐츠 등과 같은 유해 콘텐츠를 용인하지 않고 미묘하고 복잡한 문제에 대한 확실한 기준을 나타내기 위해 지난해 4월 상세한 버전의 커뮤니티 규정을 발표한 바 있다.

이날 페이스북은 다양한 사례와 함께 구체적인 내용의 커뮤니티 규정을 설명했다.

유동연 페이스북 APAC 콘텐츠 정책담당은 혐오발언의 정의에 대해 "대상이 있어야 하고 대상에 대한 공격이 있을 때 혐오발언으로 본다"면서 "혐오발언의 대상은 인종, 종교, 국적, 성적 정체성, 신체적 장애가 될 수 있으며 종교 등 신념에 대한 비판은 허용되지만 종교인에 대한 비판은 허용되지 않는다"고 설명했다.

예를 들어 '국수주의는 정신병'이란 단어는 국수주의 사상이나 국수주의자에 대한 공격이기 때문에 허용된다. 또 '결혼 생각이 없는 한국 여자'에 대한 비난은 전체 한국 여자를 일반화한 것이 아닌 특정 생각을 가진 한국 여자 일부에 대한 비난으로 허용될 수 있다.

따돌림 및 괴롭힘은 맥락과 의도가 중요하며 만 18세 이하의 미성년자를 대상으로 했을 때는 더욱 까다롭게 적용한다. 이미지가 모욕적인지 아닌지는 페이스북이 판단하지 않고 해당 콘텐츠에서 거론된 당사자가 신고를 하면 콘텐츠를 내리는 조치를 취한다.

페이스북은 자살 및 자해 관련 콘텐츠에 대해 심각하게 받아들이고 있다. 유 담당은 "자살 및 자해 관련 콘텐츠는 어떤 상황에서 포스팅을 내리는 것이 도움이 되는지, 아니면 그대로 두는 것이 도움이 되는지 등을 전문가들과 교류를 통해 조언을 구하고 있다"고 설명했다.

어떤 사람들이 자살이나 자해 관련 경험을 하고 극복한 후 자신의 마음 상태를 나누는 내용의 콘텐츠는 다른 사람에게도 도움을 줄 수 있어 허용하고 있다.

자살이나 자해 행위를 종용 또는 협력을 요청하는 콘텐츠나 자살이나 자해에 대해 긍정적인 표현을 하는 콘텐츠는 허용되지 않는다.

유 담당은 "자살이나 자해를 하는 라이브의 경우 실시간으로 콘텐츠를 내리지는 않는다"면서 "라이브가 주변 사람이 도움을 줄 수 있는 유일한 창이기 때문이다"라고 설명했다. 이어 "관련 라이브를 발견하면 해당 관할 구역 기관에 도움을 요청한다"면서 "이미 일이 일어났을 경우에는 콘텐츠를 내리지만 어떠한 방법이 최선인지는 계속 고민하고 있다"고 부연했다.

자살이나 자해 관련 콘텐츠에 대해 조치를 취할 때는 신고자와 게시 당사자에게도 도움이 될 수 있는 메시지나 도움을 요청할 수 있는 메시지를 제공한다.

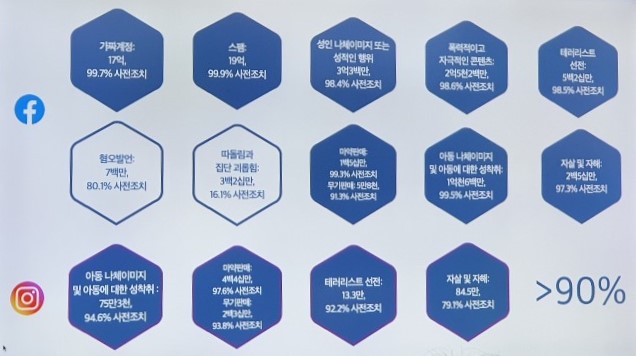

AI 사전 조치, 가짜계정·스팸·이미지 등 98% 이상

지난 13일 발간된 페이스북의 4번째 커뮤니티 규정 집행 보고서(2019년 3분기)도 발표했다. 이 보고서에는 △유포된 비율 △조치를 취한 콘텐츠 수 △사전조치율 △이용자가 이의를 제기한 콘텐츠 수 △이의제기 후 복구된 콘텐츠 수 등이 담겨있다. 전 세계에서 접수되는 신고건수가 매일 100만건이 넘는다.

이번에 조치된 가짜계정은 17억개, 스팸은 19억개, 성인 나체 이미지 또는 성적인 행위는 3억300만개, 폭력적이고 자극적인 콘텐츠는 2억5200만개, 혐오발언이 700만개, 따돌림 및 집단 괴롭힘이 3200만개였다.

이 중 가짜계정, 스팸, 성인 나체 이미지 또는 성적인 행위, 폭력적이고 자극적인 콘텐츠는 98% 이상이 사용자로부터 신고가 들어오기 전 AI(인공지능)를 통해 사전조치를 취했다. 따돌림과 집단 괴롭힘은 사전조치율이 16.1%로 비교적 낮았다.

유 담당은 "따돌림 및 집단 괴롭힘은 맥락과 의도가 중요하기 때문에 AI가 판단하기 어렵고 사용자의 신고를 굉장히 중요하게 여긴다"면서 "사전조치를 99%한다고해도 100만개 중 1%도 숫자로는 너무 많다. 사용자의 신고가 중요하다"고 말했다.